Loi géométrique

| Loi géométrique | |

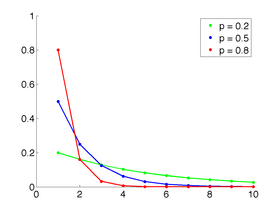

Fonction de masse | |

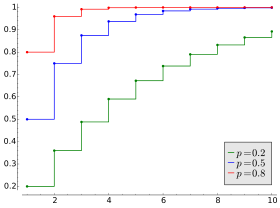

Fonction de répartition | |

| Paramètres |

|

|---|---|

| Support | |

| Fonction de masse | |

| Fonction de répartition | |

| Espérance | |

| Médiane | (pas unique si ) |

| Mode | |

| Variance | |

| Asymétrie | |

| Kurtosis normalisé | |

| Entropie | |

| Fonction génératrice des moments | |

| Fonction caractéristique | |

| Fonction génératrice des probabilités | |

modifier  | |

En théorie des probabilités, la loi géométrique de paramètre peut désigner, selon la convention choisie, l'une des deux lois de probabilité suivantes :

- la loi de probabilité d'une variable aléatoire (v.a.) comptant le nombre d'épreuves de Bernoulli indépendantes de probabilité de succès p ∈ ]0,1[ nécessaires pour obtenir le premier succès. est la variable aléatoire donnant le rang du premier succès. Le support de la loi est alors {1, 2, 3, ...}.

- La loi d'une variable aléatoire (v.a.) comptant le nombre d'échecs avant le premier succès dans une répétition d'épreuves de Bernoulli indépendantes de probabilité de succès Le support de la loi est alors {0, 1, 2, 3, ...}. On remarque que les variables aléatoires sont liées par la relation

Ces deux lois sont différentes. C'est pourquoi il faut préciser la convention choisie en indiquant le support.

Par la suite, sauf mention contraire, on considèrera que représente le rang du premier succès (le nombre d'épreuves effectuées dont celle réussie) et on notera la probabilité d'un échec dans l'épreuve de Bernoulli.

Exemples

- Supposons un dé équilibré à 6 faces. peut permettre de déterminer le nombre moyen de lancers nécessaire pour obtenir un 6. Ce nombre est l'espérance de la loi géométrique de paramètre .

- Supposons une machine à vêtements démarrant à l'instant puis opérant aux instants En chaque instant la machine a une probabilité de tomber en panne. peut permettre de modéliser le temps de fonctionnement sans panne .

Définition

Support sur les entiers strictement positifs

Soit . Alors :

La probabilité correspond à la probabilité d'obtenir dans une succession de k épreuves de Bernoulli, k – 1 échecs suivis d'un succès. Les épreuves étant indépendantes, cette probabilité est de qk – 1p. Dans la suite, nous prenons cette définition.

Support sur les entiers positifs

Pour l'autre définition, le nombre d'échecs avant succès :

n'est qu'un décalage de . Son espérance n'est pas mais . En revanche, la variance est identique pour les deux définitions.

Modèle de durée de vie et loi exponentielle

Si on appelle la probabilité de désintégration d'une particule radioactive en chaque instant, la loi géométrique est le premier modèle discret de la mort d'une particule radioactive. La durée de vie de la particule radioactive suit la loi de probabilité suivante :

Si est petit, est proche de . Donc

On retrouve la distribution de la loi exponentielle.

Espérance, variance, écart type

L'espérance d'une variable aléatoire X suivant une loi géométrique de paramètre p est 1⁄p, et sa variance est q/p2 où q = 1 – p est la probabilité d'échec :

L'écart type est donc √q/p.

Calculs préliminaires : pour tout x de [0, 1[,

Par exemple, pour , et l'écart moyen .

Liens avec d'autres lois

Lien avec la loi géométrique tronquée

Dans les programmes 2011 de Première Scientifique en France[1], on appelle loi géométrique tronquée de paramètres n et p, la loi de la variable aléatoire obtenue en limitant à n le nombre d'épreuves de Bernoulli de paramètre p et en notant k le rang du premier succès. Par convention, s'il n'advient aucun succès au cours des n essais, on pose X = 0 (on trouve parfois pour X le nombre d'échecs consécutifs obtenus avant l'obtention d'un premier succès au cours des n épreuves[2]). La probabilité que X = k est alors, pour k = 1, 2, 3, ..., n :

et pour k = 0

Cette loi de probabilité a pour espérance[1]: où q = 1 – p.

Le terme « tronquée », ici, n'a pas le même sens que celui que l'on trouve dans la définition d'une loi tronquée.

Lien avec la loi exponentielle

La loi géométrique est une version discrétisée de la loi exponentielle. En conséquence, la loi exponentielle est une limite de lois géométriques renormalisées.

Propriété — Si X suit la loi exponentielle d'espérance 1, et si alors Y suit la loi géométrique de paramètre

Notons que, pour un nombre réel x, désigne la partie entière supérieure de x, définie par

Ainsi, pour obtenir une variable aléatoire Y' suivant une loi géométrique de paramètre p arbitraire (avec toutefois la contrainte 0 < p < 1), à partir d'une variable aléatoire exponentielle X' de paramètre λ, il suffit de poser

où l'on a choisi

En effet, suit une loi exponentielle de paramètre 1 (et d'espérance 1).

Réciproquement,

Propriété — Si, pour la variable aléatoire Yn suit la loi géométrique de paramètre pn, et si, simultanément,

alors anYn converge en loi vers la loi exponentielle de paramètre λ.

On se donne une variable aléatoire exponentielle X de paramètre 1, et on pose

Alors Yn et ont même loi, en vertu de la propriété précédente. Par ailleurs, pour tout ω

Or d'une part la convergence presque sûre entraine la convergence en loi, d'autre part la loi de X/λ est la loi exponentielle de paramètre λ.

Lien avec la loi binomiale négative

Si Xn est une variable aléatoire distribuée selon la loi binomiale négative de paramètres n et p, alors Xn a même loi que la somme de n variables aléatoires indépendantes distribuées selon une loi géométrique de paramètre p.

Voir aussi

- Variables aléatoires élémentaires

- Radioactivité

- Méthode de rejet

- Processus de Bernoulli

- Loi exponentielle

- Loi binomiale négative

- Problème du collectionneur de vignettes (un exemple faisant apparaître une loi géométrique)

Notes et références

v · m Index du projet probabilités et statistiques | |||||||||||||||||||||||||||||||||||||||||||||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| |||||||||||||||||||||||||||||||||||||||||||||||||||||

Portail des probabilités et de la statistique

Portail des probabilités et de la statistique

![{\displaystyle p\in ]0;1[}](https://wikimedia.org/api/rest_v1/media/math/render/svg/308c191f8cbb93adbdf252b498ce56cbad0a81b3)

![{\displaystyle \mathbb {E} [X]={\frac {1}{p}},\qquad \mathbb {V} [X]={\frac {1-p}{p^{2}}}={\frac {q}{p^{2}}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1c45470c0681d6ec6b01db8ce5b8ef609060a565)

![{\displaystyle {\begin{aligned}\mathrm {Var} (X)&=\left(\sum _{k=1}^{+\infty }k^{2}q^{k-1}p\right)-\mathbb {E} [\mathrm {X} ]^{2}\\&={\frac {2p}{(1-q)^{3}}}-{\frac {p}{(1-q)^{2}}}-{\frac {1}{p^{2}}}\\&={\frac {2}{p^{2}}}-{\frac {1}{p}}-{\frac {1}{p^{2}}}\\&={\frac {q}{p^{2}}},\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/eb76e40124b938dabc631c1f411d53a947a49c7b)

![{\displaystyle \mathbb {E} [X]=2,\mathbb {V} [X]=2,\sigma [X]={\sqrt {2}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/975a1a34c2596ae64c7077b163227ab5e83d5618)

![{\displaystyle {\begin{aligned}\mathbb {P} (Y=k)&=\mathbb {P} (\lceil \theta X\rceil =k)\\&=\mathbb {P} (\theta X\in ]k-1,k])\\&=\mathbb {P} \left(X\in \left]{\tfrac {k-1}{\theta }},{\tfrac {k}{\theta }}\right]\right)\\&=F_{X}\left({\tfrac {k}{\theta }}\right)-F_{X}\left({\tfrac {k-1}{\theta }}\right)\\&=\exp \left(-\ {\tfrac {k-1}{\theta }}\right)-\exp \left(-\ {\tfrac {k}{\theta }}\right)\\&=\left(\mathrm {e} ^{-\ {\tfrac {1}{\theta }}}\right)^{k-1}\ \left(1-\mathrm {e} ^{-\ {\tfrac {1}{\theta }}}\right).\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d26eb9e174de0e7af0a22a85541836596cb4c8ac)